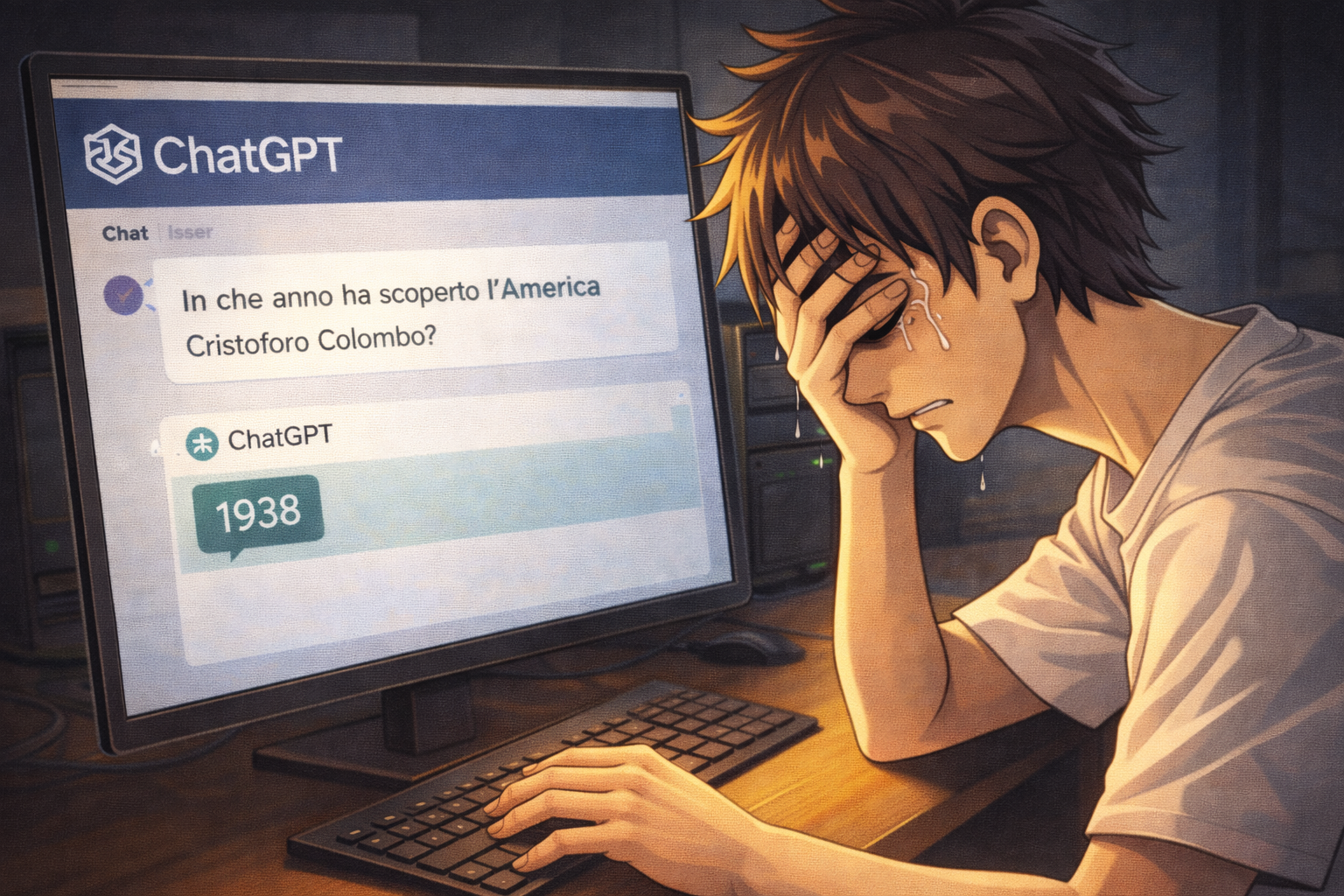

Hai fatto una domanda precisa. ChatGPT ha risposto con sicurezza, nel dettaglio, senza esitazioni. Solo dopo hai scoperto che quella data era sbagliata, quella fonte non esisteva, quel fatto era completamente inventato.

Eppure il tono era quello di chi sa perfettamente di cosa parla.

Questo succede più spesso di quanto si pensi. E non è un difetto occasionale: è qualcosa di strutturale nel modo in cui funzionano questi strumenti. Capire perché ti aiuta a usarli in modo molto più efficace.

ChatGPT ti ha dato una risposta sbagliata — e sembrava sicuro

Chi usa ChatGPT da un po’ di tempo conosce bene questa sensazione. Fai una domanda, ricevi una risposta articolata, ben strutturata, con dettagli specifici. La leggi e pensi: ottimo, problema risolto.

Poi vai a verificare. E scopri che quel dato non torna, quella citazione non esiste, quella statistica è diversa da quella reale. A volte l’errore è piccolo. A volte è così evidente che ci si chiede come sia possibile.

Il punto che sorprende di più non è l’errore in sé: è il tono con cui viene presentato. ChatGPT non dice “potrebbe essere”, non aggiunge “non sono sicuro”. Risponde con la stessa sicurezza sia quando ha ragione sia quando inventa completamente.

Questo rende il problema molto più difficile da gestire rispetto a un normale errore di distrazione. Non ci sono segnali visibili che indicano quando fidarsi e quando no. E allora viene spontanea una domanda: perché lo fa?

Perché ChatGPT inventa cose invece di dire "non lo so"

La risposta sta nel modo in cui questi strumenti sono costruiti. ChatGPT non cerca informazioni su internet in tempo reale (a meno che non abbia la navigazione attiva). Non consulta fonti mentre parla. Genera testo parola per parola, scegliendo ogni volta la continuazione statisticamente più probabile in base a tutto ciò che ha letto durante l’addestramento.

In pratica: non sa, ma completa. Come un parlante molto fluente che continua una frase anche quando non conosce la risposta esatta, scegliendo le parole che suonano più plausibili in quel contesto.

Il problema è che questo meccanismo non distingue tra “so la risposta” e “sto producendo qualcosa che sembra una risposta”. Per il modello non c’è differenza: in entrambi i casi genera testo coerente e fluido. È quello che i tecnici chiamano allucinazione AI. Anche se il termine è fuorviante — non c’è niente di onirico — è semplicemente una generazione di testo non ancorata a fatti reali.

Questo è anche il motivo per cui ChatGPT non dice quasi mai “non lo so” in modo spontaneo: non è addestrato a fermarsi, ma a produrre sempre una risposta. Se vuoi capire questo fenomeno in modo più approfondito, il punto di riferimento è l’articolo dedicato: Cosa sono le allucinazioni AI e come evitarle.

Quando ChatGPT sbaglia di più: i casi più comuni

Non tutte le risposte hanno la stessa probabilità di essere inventate. Ci sono contesti in cui il rischio di errore sale in modo significativo.

Dati precisi e numeri: date, statistiche, percentuali, prezzi, cifre storiche. Quando la risposta corretta richiede un valore esatto, ChatGPT spesso ne produce uno plausibile ma sbagliato.

Fonti e citazioni: titoli di libri, autori, articoli scientifici, link. Le allucinazioni sono particolarmente frequenti qui — ChatGPT può citare libri mai scritti, paper con DOI inesistenti, studi attribuiti agli autori sbagliati.

Informazioni recenti: tutto ciò che è accaduto dopo la data limite dei suoi dati di addestramento. ChatGPT può rispondere come se conoscesse eventi recenti, ma in realtà sta costruendo scenari plausibili basandosi su tendenze passate.

Argomenti di nicchia: più l’argomento è specifico e meno frequente nei testi di addestramento, più il modello tende a riempire i vuoti con dettagli inventati.

C’è però un caso che si verifica molto più spesso di quanto si pensi e che vale la pena conoscere: quando si fornisce a ChatGPT dati parziali chiedendo un’analisi o un completamento. In questi casi il modello non si ferma sui dati ricevuti — li usa come base e stima il resto, producendo numeri, percentuali o dettagli aggiuntivi che sembrano coerenti con quelli forniti. Non li inventa a caso: li calcola per analogia, per proporzione, per plausibilità. Ma restano stime, non fatti. È esattamente lo scenario in cui le allucinazioni sono più difficili da riconoscere, perché il risultato finale sembra quasi giusto.

Vale la pena ricordare che su argomenti generali, concetti consolidati e spiegazioni di principi, ChatGPT è spesso affidabile. Il problema sorge quando si entra nel dettaglio. Per capire quando e quanto fidarsi in base al tipo di domanda, puoi leggere: ChatGPT è affidabile? Quando fidarsi e quando no.

Come evitare le risposte inventate: metodo pratico

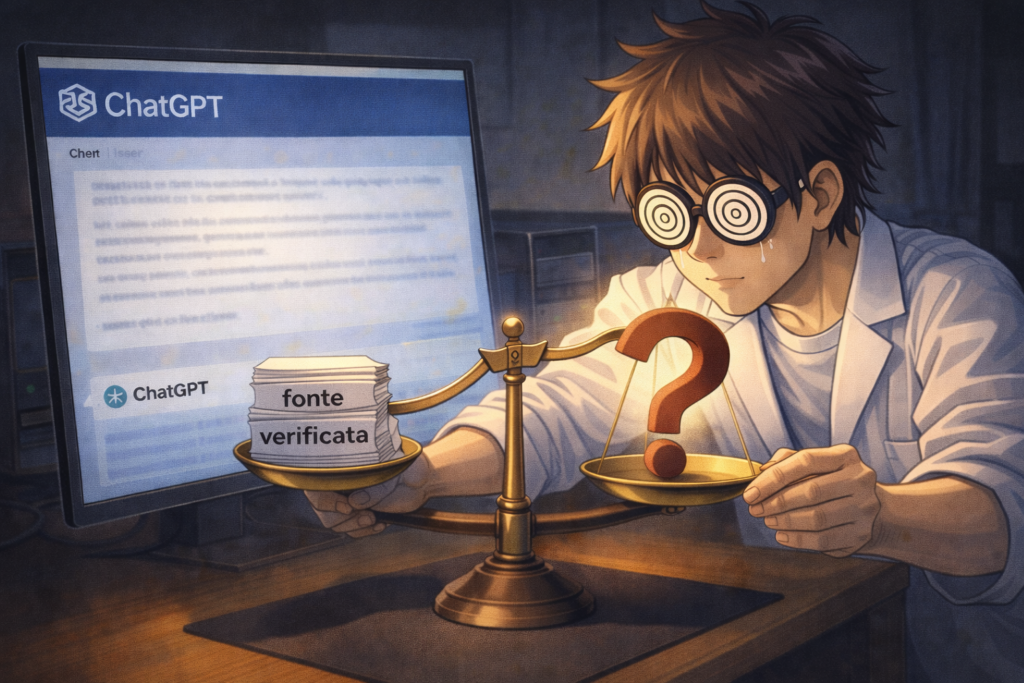

Non esiste un modo per eliminare completamente il rischio di allucinazioni. Ma si può ridurlo in modo significativo con alcune abitudini semplici.

Chiedi sempre le fonti esplicitamente. Un prompt come “rispondi e indica le fonti specifiche” non garantisce fonti reali, ma rende più facile verificarle. Se le fonti citate non esistono o non trattano l’argomento, è un segnale chiaro.

Verifica i dati importanti fuori da ChatGPT. Per qualsiasi informazione che userai in un documento, una presentazione o una decisione, la verifica su una fonte primaria non è opzionale. ChatGPT è un punto di partenza, non una fonte.

Usa ChatGPT per ragionare, non per ricordare. Su concetti, strutture logiche, spiegazioni di principi funziona molto bene. Sui fatti specifici, meno. Impostare il proprio uso in questo modo riduce le aspettative sbagliate.

Attiva la navigazione web quando serve. Quando hai bisogno di informazioni recenti o verificabili, usa ChatGPT con la navigazione attiva. In quel caso il modello recupera dati reali invece di generarli.

Una regola pratica: più la risposta richiede un dato preciso e verificabile, più vale la pena controllare. Più la domanda è concettuale o strutturale, più ci si può fidare del risultato.

Cosa fare quando ChatGPT ti dà informazioni sbagliate

Prima di tutto: non fidarti del secondo tentativo in automatico. Se chiedi “sei sicuro?” a ChatGPT dopo una risposta errata, spesso corregge — ma non sempre nel modo giusto. A volte produce una seconda versione altrettanto sbagliata, con la stessa sicurezza della prima.

Il modo più efficace per gestire una risposta sospetta è uscire dalla chat e verificare. Non riformulare la domanda sperando in un risultato diverso. Andare a controllare su una fonte esterna.

Se lavori su un documento o un contenuto specifico, può essere utile chiedere a ChatGPT di segnalare esplicitamente i punti dove non è sicuro: “indica con [da verificare] ogni affermazione che potrebbe essere imprecisa”. Non è infallibile, ma spesso migliora la qualità dell’output.

L’errore più costoso non è ricevere una risposta sbagliata: è pubblicare o usare quella risposta senza averla controllata. ChatGPT sbaglia con sicurezza. Il lavoro di verifica resta in capo a chi usa lo strumento.

Se stai costruendo un flusso di lavoro in cui usi l’AI per produrre contenuti o testi in modo continuativo, puoi leggere anche: Scrivere articoli e blog con l’AI: come ottenere contenuti di qualità con ChatGPT.