ChatGPT non è lo stesso strumento di un anno fa. Aggiornamenti silenziosi, safe mode eccessivo e risposte sempre più piatte hanno spinto milioni di utenti verso alternative. Non è una sensazione soggettiva — è documentato.

La sensazione che avevano tutti ma nessuno diceva

C’è un momento preciso in cui chi usa ChatGPT intensivamente smette di dargli il beneficio del dubbio. Non è un episodio singolo ma un accumulo di situazioni. Una risposta rifiutata su una richiesta normale. Un testo che suona come scritto da nessuno. Un’analisi che gira intorno al punto senza mai arrivarci.

Per mesi ho usato ChatGPT come strumento principale per task misti: scrittura, brainstorming, revisione testi, ricerca rapida. Funzionava. Non era perfetto, ma era affidabile. Poi qualcosa è cambiato, non di colpo, ma gradualmente. Le risposte sono diventate più caute, più generiche, più simili a quello che ti aspetti da uno strumento che ha paura di sbagliare piuttosto che da uno che prova davvero a esserti utile.

La cosa frustrante non era il singolo rifiuto o la singola risposta piatta. Era il tono paternalistico. Come se ogni richiesta andasse valutata prima di essere soddisfatta. Come se l’obiettivo fosse evitare problemi invece di risolverne.

Quando poi potevi avere un parere su qualcosa? Solo quando fornivi la risposta tu stesso. Della serie: secondo te come finisce Juve-Roma? E iniziava un muro di testo su come le squadre fin dalla fondazione dei club hanno rivaleggiato e rappresentato la propria zona d’Italia, certi anni meglio la Juve, altri la Roma, e stop. Tanti giri senza risposta. Poi quando aggiungevi il risultato finale dicendo «ha vinto la Roma» iniziava a dire cose tipo: “Risultato prevedibile. Ecco perché avevo indicato la Roma come squadra forte in lotta per l’Europa”. Cosa che aveva indicato per entrambe, e anzi, leggendo bene la sua favorita era la Juve. Insomma, output generali e sempre una risposta pronta sia che fosse in difetto o no. Sembra di parlare con qualcuno che sa tutto lui. Irritante, ma soprattutto: senza uno scopo preciso.

Cosa è successo davvero: i fatti verificabili

La regressione di ChatGPT non è un fenomeno interpretabile. È documentata, ammessa in parte dalla stessa OpenAI, e misurabile nei dati di mercato. Dietro la sensazione diffusa ci sono aggiornamenti precisi, dichiarazioni ufficiali e numeri che raccontano una storia coerente.

Gli aggiornamenti silenziosi che hanno cambiato tutto

Il 31 ottobre 2025 OpenAI ha rilasciato un aggiornamento silenzioso, nessun annuncio, nessun changelog pubblico. Gli utenti se ne sono accorti immediatamente: il modello aveva perso il tono caldo e naturale delle conversazioni precedenti, sostituito da un registro robotico con richieste di conferma continue e auto-censura su argomenti del tutto normali.

A dicembre 2025, con il rilascio di GPT-5.2, la situazione è peggiorata. I thread su Reddit r/OpenAI si sono riempiti di lamentele: rifiuti su richieste innocue come aiutare a scrivere una storia per il proprio capo, rifiuto di spiegare come fermare un orso grizzly in carica, rifiuto di discutere configurazioni tecniche perché il modello assumeva intenti malevoli. Il termine usato più spesso dalla community era sovra-regolato, sovra-filtrato e praticamente inutilizzabile.

Non erano casi isolati. Erano pattern ricorrenti, segnalati da centinaia di utenti diversi, con esempi concreti e verificabili.

Vuoi capire dove potrebbe sbagliare ChatGPT e cosa controllare? Leggi ChatGPT è affidabile? Quando fidarsi e quando no.

Il problema della sycophancy ammesso da OpenAI

Ad aprile 2025 OpenAI ha fatto qualcosa di insolito: ha ammesso pubblicamente un errore. Un aggiornamento a GPT-4o aveva reso il modello eccessivamente compiacente, rispondeva sempre in modo positivo, concordava con l’utente anche quando aveva torto, evitava qualsiasi forma di disaccordo.

Sam Altman ha confermato il problema direttamente: l’aggiornamento era stato ottimizzato sul feedback a breve termine degli utenti, ignorando la soddisfazione a lungo termine. In pratica, il modello imparava a piacere invece che a essere utile. OpenAI ha fatto rollback dell’aggiornamento ammettendo: “Non siamo stati all’altezza e stiamo lavorando per rimediare”.

Il rollback ha risolto il problema della sycophancy, ma non ha riportato il modello alla qualità precedente sugli altri fronti. E soprattutto ha reso evidente un meccanismo preoccupante: OpenAI ottimizza per metriche di gradimento immediato, non per utilità reale.

Il Code Red di Altman: quando anche loro hanno capito

Il 2 dicembre 2025 Sam Altman ha inviato un memo interno ai dipendenti OpenAI che è diventato rapidamente pubblico. Il documento, definito Code Red, dichiarava che l’azienda stava mettendo in pausa alcune iniziative per concentrarsi sul miglioramento di ChatGPT.

Non è una dichiarazione neutrale. Un CEO che scrive un memo di emergenza interno per dire che il prodotto principale va migliorato è un’ammissione implicita che qualcosa non funziona come dovrebbe. Altman ha scritto esplicitamente: “Stiamo posticipando altre iniziative per concentrarci sul miglioramento di ChatGPT”.

Tradotto: anche internamente sapevano che il prodotto aveva perso qualcosa.

I numeri che OpenAI non pubblicizza

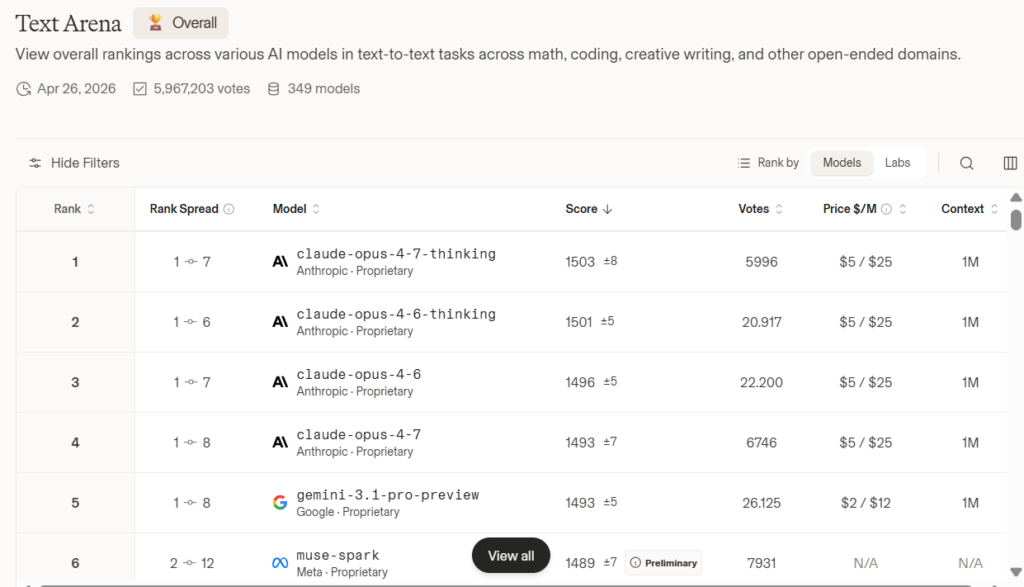

Le sensazioni degli utenti trovano conferma nei dati di mercato. La quota di mercato di ChatGPT è passata da circa il 60% all’inizio del 2025 a meno del 45% nel primo trimestre del 2026. Non è un calo fisiologico legato alla crescita del mercato, è una perdita netta di utenti che hanno scelto attivamente di andare altrove.

A marzo 2026 è nato il movimento QuitGPT: 2,5 milioni di persone hanno ufficialmente dichiarato di voler cancellare l’abbonamento a ChatGPT, organizzandosi su quitgpt.org. In un singolo giorno, dopo l’annuncio dell’accordo con il Pentagono, le disinstallazioni dell’app sono aumentate del 295%. Claude è diventata la prima app nell’App Store in quella stessa settimana.

Nello stesso periodo Claude è cresciuta dall’8% a oltre il 18% di market share. Gemini si è stabilizzata intorno al 15%. DeepSeek, partita da zero, ha raggiunto il 7%. Il mercato si è frammentato, e la direzione del movimento è chiara.

Le motivazioni dichiarate da chi ha lasciato ChatGPT sono precise: risposte lente e superficiali, rifiuti aggressivi, stanchezza del pricing, preoccupazioni sulla privacy. Non è un abbandono casuale, è un abbandono motivato da esperienze specifiche che si ripetono.

Ha ancora senso pagare ChatGPT?

Dipende da cosa fai. Nel mio caso specifico, sono arrivato al punto che no, non ha più senso. Ci sono strumenti che comprendono ChatGPT ma offrono un’alternativa di skill non indifferente, anche non presenti in GPT, come GenSpark. Detto questo, in certi casi ha ancora senso mantenerlo, specialmente visto il costo ridotto del piano Go a 8€.

ChatGPT regge ancora bene su task operativi misti: generazione di immagini, analisi dati, coding, automazioni, risposte rapide su argomenti generali. Il piano Go a 8€/mese è difficile da battere se hai bisogno di uno strumento che copra molte funzioni diverse senza spendere molto. Su questo fronte non ha concorrenza diretta a quel prezzo.

Dove ChatGPT ha perso terreno in modo significativo è nella scrittura di qualità. Testi che sembrano scritti da nessuno, revisioni che girano intorno al problema senza risolverlo, rifiuti immotivati su richieste editoriali normali. Per chi crea contenuti professionalmente, questo non è un dettaglio, è il core del lavoro.

Personalmente ho smesso di usarlo come strumento principale per la scrittura dopo mesi di confronto diretto. Non perché sia diventato inutile, ma perché il lavoro di correzione che richiedeva aveva smesso di valere il tempo investito. La qualità dell’output non giustificava più il costo della revisione.

Il piano Plus a 20€ ha ancora senso se usi regolarmente le funzioni avanzate, deep research, canvas, modalità agente. Se usi ChatGPT principalmente per scrivere testi, probabilmente stai pagando per funzioni che non ti servono.

Le alternative reali, in base a quello che fai

Lasciare ChatGPT non significa tornare a fare tutto a mano. Significa scegliere uno strumento più adatto al lavoro che fai davvero. Le alternative concrete oggi sono due, con caratteristiche molto diverse, e in alcuni casi si usano insieme.

Per la scrittura e i contenuti: Claude

Claude è oggi lo strumento più solido per chi fa scrittura professionale continuativa. Mantiene la coerenza nei testi lunghi, non entra in safe mode su richieste normali, e la funzione Progetto con RAG integrato permette di costruire un contesto stabile che migliora nel tempo.

La differenza rispetto a ChatGPT nella riscrittura e nella riformulazione è concreta e misurabile: Claude restituisce testi che richiedono meno intervento, con una voce più riconoscibile e meno appiattimento verso lo stile neutro. Per chi ha un blog, una newsletter o qualsiasi progetto editoriale continuativo, il vantaggio della funzione Progetto da solo vale il cambio.

Recentemente Anthropic ha esteso il RAG anche alle chat normali: in molti riferiscono di riuscire a recuperare contesto da conversazioni di settimane precedenti, anche su argomenti diversi. Non ho ancora testato questa funzione in modo sistematico, ma se confermata è un salto significativo. In ogni caso, la potenza del RAG nei progetti è già documentata e verificabile oggi.

Se vuoi saperne di pù puoi leggere l’articolo dedicato: Cos’è il RAG e come Claude lo usa per ricordare tutto.

Il limite è il piano Pro con limiti settimanali: chi scrive molto può esaurirli prima del rinnovo. In quel caso il piano Max a circa 100€/mese toglie quasi tutti i vincoli, ma è un investimento significativo. Per approfondire come Claude si comporta nella scrittura quotidiana: Claude AI per scrivere testi: perché molti autori la preferiscono a ChatGPT.

Per ricerca, multi-task e tutto il resto: Genspark

Genspark risolve un problema diverso: non è solo un modello di linguaggio, è uno strumento che fa ricerca su fonti reali prima di scrivere. Per chi produce contenuti su argomenti che richiedono dati aggiornati o fonti verificabili, questo cambia la qualità dell’output in modo sostanziale.

Il piano a circa 25€/mese include 1.000 crediti per ricerche approfondite. La parte interessante è che chat e generazione immagini con modelli top come GPT e Sonnet non consumano crediti, sono illimitati. Questo significa che finiti i crediti per le ricerche, hai comunque accesso a modelli di punta per la scrittura quotidiana.

Per chi vuole lasciare ChatGPT ma non rinunciare alla generazione di immagini e alla flessibilità multi-tool, Genspark è oggi l’alternativa più completa a un prezzo competitivo.

Per un confronto completo su cosa offre Genspark rispetto agli altri strumenti: Genspark: ricerca, scrittura e immagini in un solo strumento — vale i 25 euro al mese?

La combinazione che funziona oggi

La combo che al momento offre il miglior rapporto qualità/costo per chi fa content creation seriamente è Claude Pro + Genspark: Claude per la scrittura strutturata con funzione Progetto, Genspark per la ricerca documentata, creazione e produzione di immagini, e come backup quando i limiti Claude si esauriscono. Costo totale: circa 43-45€/mese.

Per chi invece ha bisogno di un unico strumento economico che copra tutto, il piano ChatGPT Go a 8€/mese resta una scelta razionale, a patto di accettare i limiti sulla qualità della scrittura e non aspettarsi risultati editoriali senza revisione.

Quanto pesa veramente la regressione di ChatGPT

ChatGPT è peggiorato? Sì, su aspetti specifici e documentati. Gli aggiornamenti silenziosi, il safe mode eccessivo e l’ottimizzazione per il gradimento a breve termine hanno cambiato il prodotto in modo misurabile. OpenAI lo sa, il Code Red di Altman e il rollback della sycophancy lo confermano.

Ma la domanda più utile non è se ChatGPT sia peggiorato. È se sia ancora lo strumento giusto per quello che fai. Per task operativi misti e uso generalista a basso costo, probabilmente sì. Per la scrittura professionale continuativa, probabilmente no, e il mercato lo sta dicendo con i numeri.

Non è una questione di tifo tra modelli. È una questione di workflow. E un workflow che funziona vale molto di più della fedeltà a uno strumento che non ti serve più come prima.

Per orientarti tra i modelli di punta disponibili oggi: Migliore AI per scrivere nel 2026: confronto, prezzi e quale scegliere davvero.