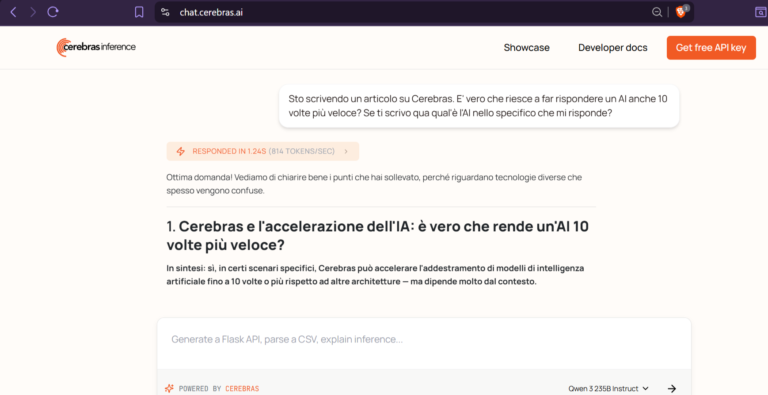

Hai mai notato quanto sono veloci certi modelli AI? Magari è successo usando Leo di Brave, il browser con AI integrata: fai una domanda e la risposta arriva quasi in tempo reale. Nessuna attesa, nessun cursore che lampeggia per secondi. Velocità anomala, del tipo che ti fa alzare un sopracciglio.

La prima domanda che viene in mente è: perché questo modello è così veloce? Non è ChatGPT, non è Claude. Eppure risponde più in fretta di quanto ti aspetteresti.

La risposta non sta nel modello in sé, ma nell’infrastruttura che lo fa girare. Quella infrastruttura si chiama Cerebras.

Cos'è Cerebras e come funziona

Cerebras Systems è un’azienda americana che ha costruito il chip più grande mai prodotto per l’intelligenza artificiale. Si chiama WSE-3 — Wafer Scale Engine, terza generazione — ed è letteralmente un wafer intero di silicio.

Per capire cosa significa, bisogna sapere come funziona la produzione normale dei chip. Solitamente un wafer di silicio — il disco che esce dalla fabbrica — viene tagliato in centinaia di pezzi più piccoli: quelli sono i chip che finiscono nelle schede grafiche, nei computer, negli smartphone. Ogni pezzo è una CPU o una GPU.

Cerebras ha fatto la cosa opposta: ha tenuto il wafer intero. Un unico chip grande quanto un piatto da portata, invece di centinaia di chip piccoli. Il risultato è il WSE-3: 46.225 mm² di superficie, contro gli 826 mm² di una GPU Nvidia H100 (grande quanto l’unghia del pollice, per capirsi). Circa 57 volte più grande.

Dentro ci sono 4 trilioni di transistor, 900.000 core ottimizzati per l’AI e una potenza di calcolo di 125 petaflop [tooltip: petaflop]. Consuma 23 kilowatt — circa quanto 15 PC da gaming accesi contemporaneamente, tutti insieme, in una sola macchina. Dentro quella scatola c’è più potenza di calcolo di quanta ne serva alla maggior parte delle organizzazioni del mondo per addestrare modelli AI.

Perché questa architettura rende i modelli così veloci

La velocità di Cerebras non viene solo dalla potenza bruta. Viene da come è costruito il chip.

In un sistema GPU tradizionale, il calcolo avviene su decine o centinaia di chip separati che devono continuamente scambiarsi dati. Ogni trasferimento tra chip costa tempo che si va a sommare, rallentando la velocità finale. Più il modello è grande, più questi trasferimenti pesano sul risultato.

Su Cerebras tutto avviene su un unico chip. I 900.000 core comunicano tra loro attraverso connessioni interne al wafer, senza dover passare da cavi, switch o protocolli esterni. La latenza crolla, la velocità sale.

Il risultato pratico è quello che si percepisce quando si usa Qwen o Llama su un’infrastruttura Cerebras: le risposte arrivano in modo notevolmente più rapido rispetto agli stessi modelli su hardware standard.

Qui nasce però una domanda legittima: se Cerebras è così veloce, perché non ci trovi ChatGPT o Claude? E soprattutto — i modelli che ci girano sopra sono davvero competitivi? Su questo vale la pena leggere: I modelli AI gratuiti sono davvero inferiori a ChatGPT e Claude?

Perché su Cerebras non trovi ChatGPT o Claude

La risposta è semplice: ChatGPT e Claude sono modelli proprietari. Anthropic e OpenAI non rilasciano i pesi dei loro modelli — cioè i miliardi di parametri numerici che determinano come il modello ragiona e risponde. Senza i pesi, nessuno può far girare quei modelli su altra infrastruttura.

Cerebras funziona solo con modelli open weight [tooltip: modelli open weight]: modelli i cui pesi sono pubblicamente disponibili, come Llama di Meta, Qwen di Alibaba o DeepSeek. Chiunque può scaricarli, farli girare su hardware proprio, ottimizzarli.

Non è una limitazione di Cerebras: è la natura stessa del mercato AI, diviso tra chi tiene tutto chiuso e chi apre il codice. Per capire questa distinzione in profondità — e cosa cambia davvero per chi usa l’AI — puoi leggere: Modelli proprietari vs open weight: cosa cambia davvero.

Dove trovi Cerebras oggi e cosa ci gira sopra

Non devi comprare un CS-3 da 2-3 milioni di dollari per usare Cerebras. L’infrastruttura è già accessibile in diversi modi, alcuni completamente gratuiti.

Il più immediato — e gratuito — è Leo di Brave Browser: l’assistente AI integrato nel browser seleziona automaticamente Cerebras come backend per alcuni modelli, tra cui Qwen. Zero configurazione, zero costi.

Chi vuole più controllo può accedere a Cerebras tramite API diretta su cerebras.ai, oppure attraverso aggregatori come Hugging Face e Vercel. I modelli disponibili includono le versioni più recenti di Llama, Qwen e DeepSeek.

Se non vuoi scegliere quale modello usare e preferisci avere tutto in un unico posto — Cerebras, ma anche tutti gli altri — vale la pena scoprire OpenRouter: un unico accesso a decine di modelli, pagando solo quello che usi. OpenRouter: cos’è e come accedere a tutti i modelli AI senza abbonamenti.