MoE: l’architettura che ha reso possibile l’AI moderna

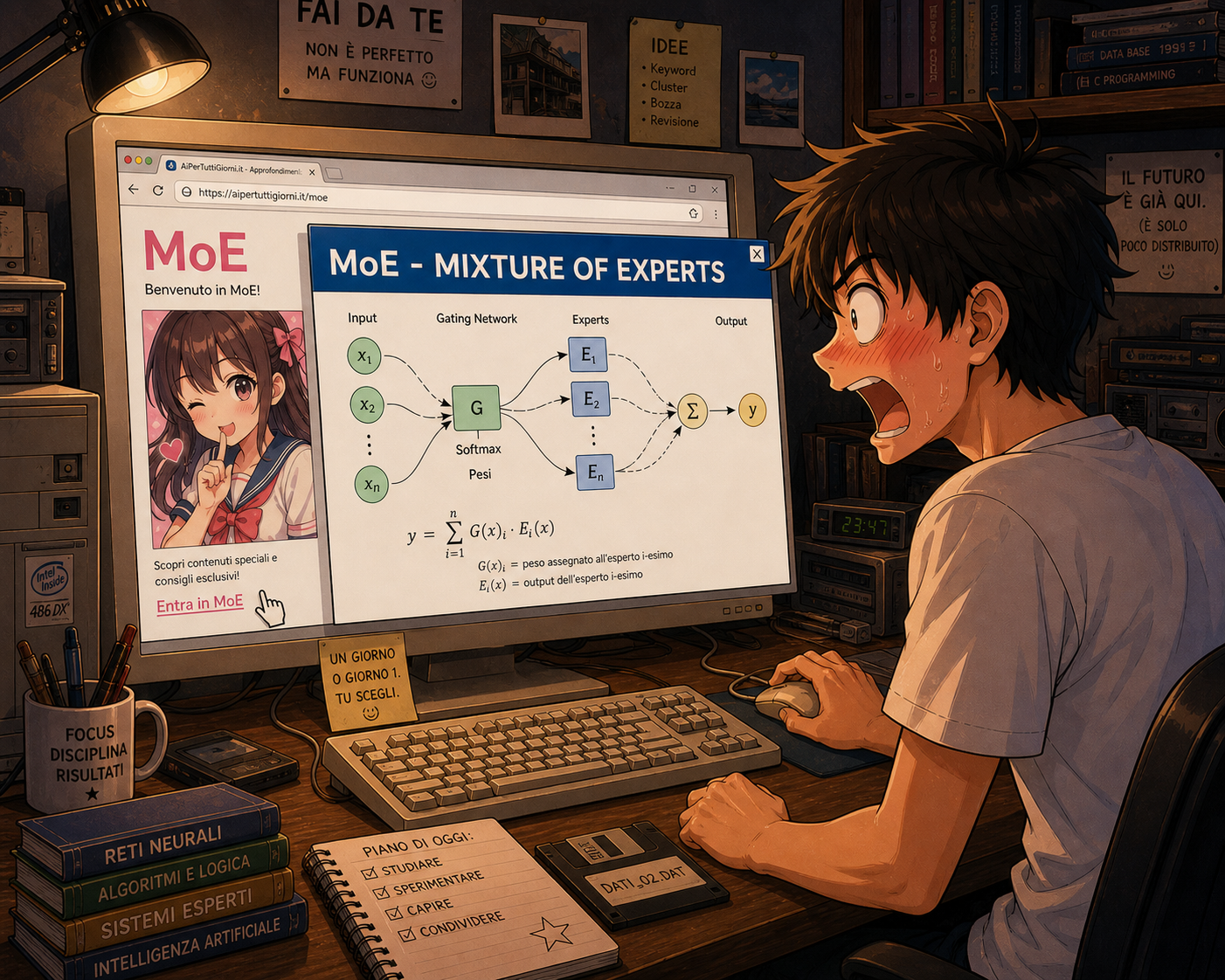

La Mixture of Experts è l’architettura AI che permette a un modello da trilioni di parametri di rispondere con il costo computazionale di uno molto più piccolo. È rimasta ferma per vent’anni. Poi è diventata il cuore di GPT-4, Gemini e DeepSeek. Il problema: i modelli AI costano troppo per quello che fanno Ogni volta … Leggi tutto